在科技飞速发展的今天,互联网正逐步迈向一个新的时代。在这个时代,边缘计算成为了一个不可忽视的重要趋势。它不仅能够提高网站和应用的性能,还能为全球用户提供更快、更安全的体验。本文将探讨边缘计算如何改变我们对互联网的理解,以及它对开发者和用户的深远影响。

边缘计算的基本概念

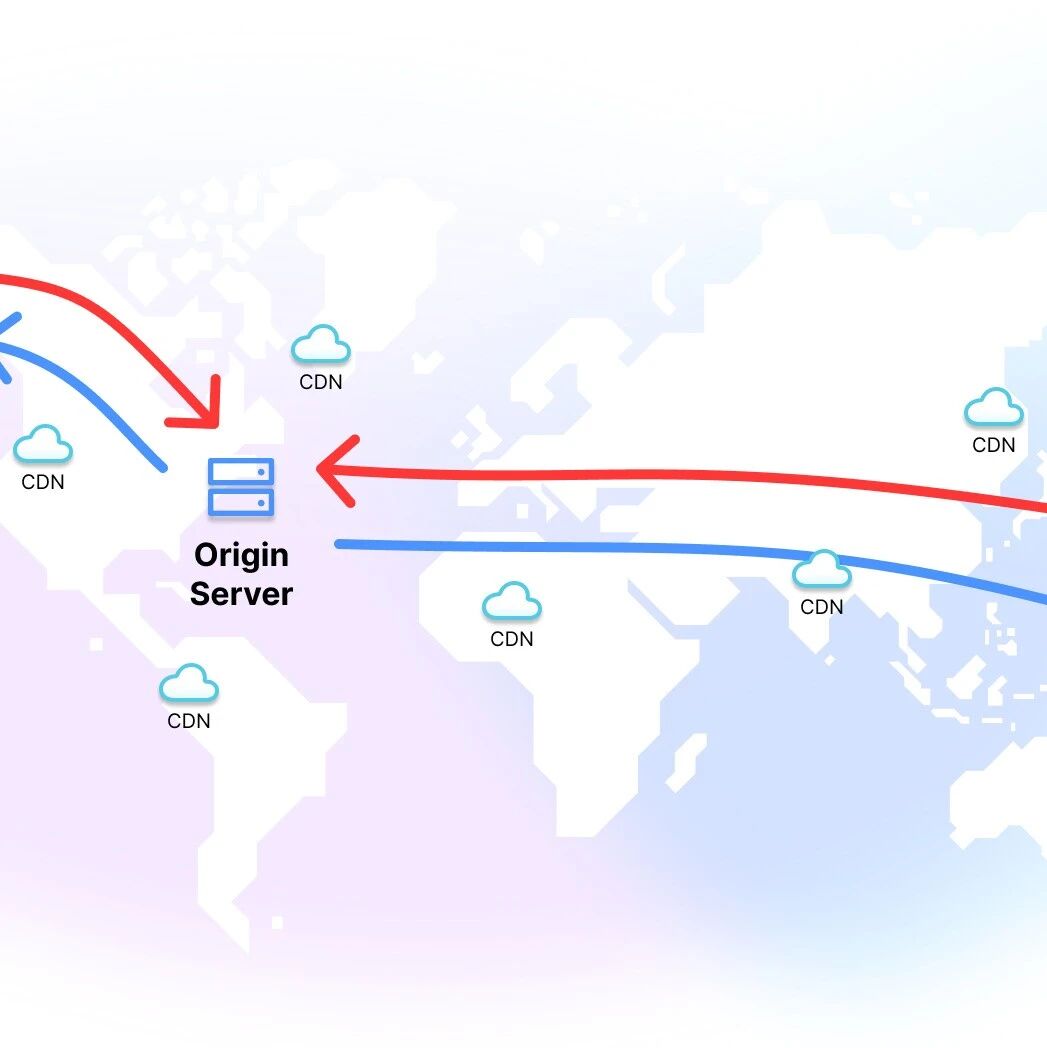

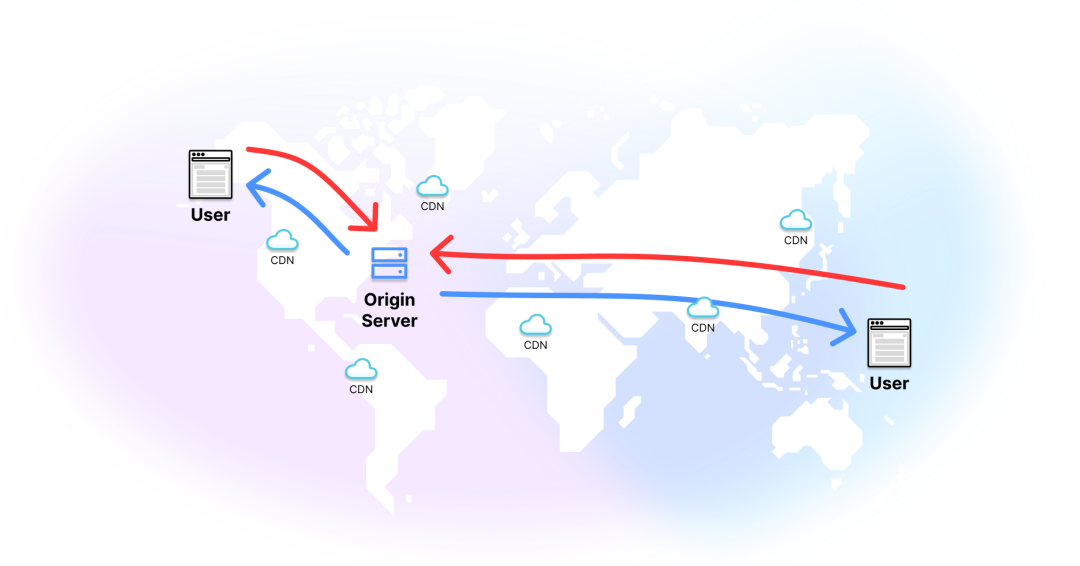

首先,我们需要了解什么是边缘计算。简单来说,边缘计算指的是将计算和数据存储从传统的集中式数据中心转移到更靠近用户的地理位置。这意味着网站或应用程序不再只托管在单一服务器上,而是同时存在于全球多个服务器上。当用户请求访问网站或应用时,系统会将其指引到离他们最近的服务器上。这种方式不仅能减少延迟,还能提供更快的响应时间。

边缘计算的技术优势

在传统的集中式服务器模型中,所有请求都需要经过中心服务器处理,这可能导致延迟增加,特别是对于距离服务器较远的用户。而通过边缘计算,服务器可以更靠近用户所在的地理位置,大大减少了数据传输的距离和时间。这种优化的物理布局能够显著提升页面加载速度,从而减少用户流失。

根据谷歌的研究显示,当页面加载时间从 1 秒增加到 3 秒时,用户流失率增加了 32%;而当加载时间达到 5 秒时,流失率则增加到 90%。在边缘计算的帮助下,许多网站能够保持较低的延迟,提升用户体验。

解决全球性能问题

举个例子,如果你在美国北弗吉尼亚的 AWS 数据中心托管一个应用程序,虽然这对美国东海岸的用户来说响应迅速,但对于其他地区的用户来说,响应时间可能就没那么理想了。对于位于德国法兰克福的用户,请求可能需要 339.95 毫秒才能得到响应;而对于新加坡和悉尼的用户,这一时间可能高达 944.14 毫秒和 889.85 毫秒。

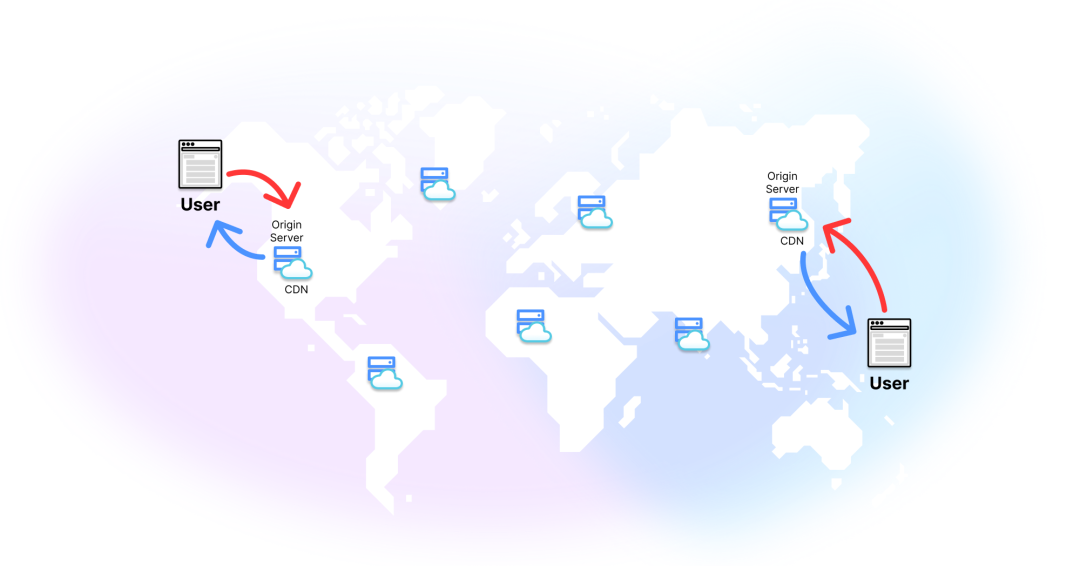

通过使用边缘计算,如 Deno Deploy,服务器可以更靠近用户。以 Deno 为例,除新加坡外,全球大部分地区的响应时间都在 100 毫秒以内。这是因为系统会自动选择离用户最近的边缘服务器,确保最快的响应时间。

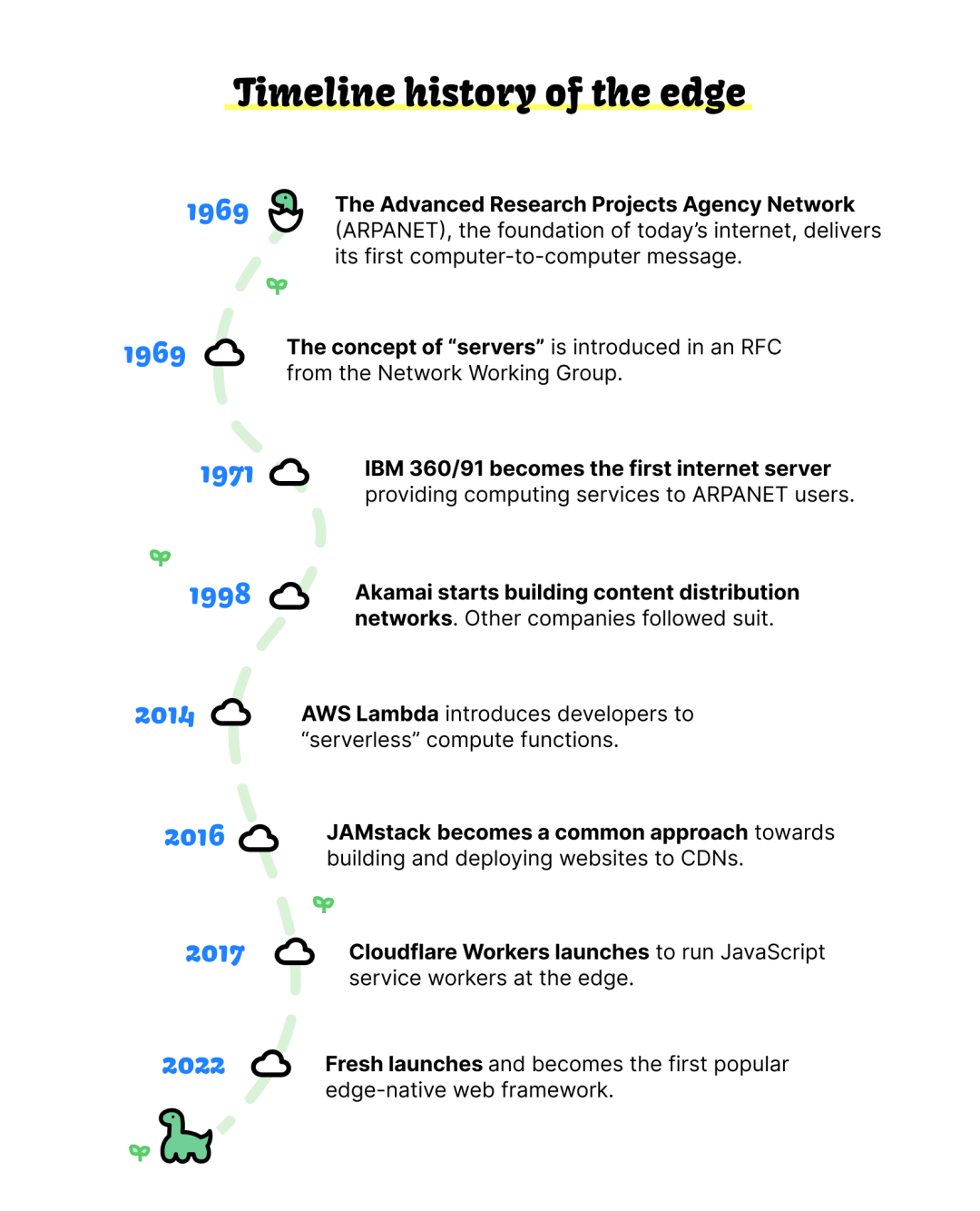

边缘计算的历史演变

边缘计算并不是凭空产生的,它是互联网技术不断演进的结果。1969 年的 RFC 提出了服务器的概念,这为后来的网络发展奠定了基础。随着互联网的普及和网站流量的激增,CDN(内容分发网络)应运而生。Akamai 在 1998 年推出的首个 CDN,解决了“热点”问题,即服务器因流量过大而崩溃的问题。CDN 通过在全球范围内缓存静态内容,将用户请求引导至最近的服务器,提高了响应速度。

而无服务器架构的出现,则为开发者提供了一种更加灵活和高效的方式来部署应用程序。AWS Lambda 是首个广泛使用的无服务器框架,通过事件驱动的方式,服务器仅在有请求时 才会启动,减少了资源的浪费。

边缘计算的优越性

边缘计算结合了 CDN 的地理优势和无服务器架构的动态优势。通过在用户附近执行自定义代码,边缘计算带来了以下几大好处:

提升性能

边缘计算的最大优势在于性能的提升。网站和应用程序在接近用户的边缘服务器上运行,响应速度更快。此外,计算在边缘服务器上进行,而不是在用户的浏览器中,这使得应用程序对用户设备的资源占用更少,减少了 CPU 和内存的使用,并降低了浏览器崩溃的风险。同时,发送给用户的数据量更小,带宽使用更少,确保了函数和 API 的一致性行为。

增强安全性

将计算从客户端转移到边缘服务器也减少了应用程序受到攻击的风险。正如 Deno 的 DX 工程负责人 Kitson Kelly 所说,“这意味着你立即减少了暴露给终端用户的攻击面。”在边缘服务器上执行计算,减少了与后端服务的 API 调用,从而提升了安全性。此外,边缘计算还能有效抵御 DDoS 攻击,因为攻击者需要同时攻击全球数十甚至数百个服务器才能奏效。

改善开发者体验

尽管目前为边缘开发代码较为复杂,但这主要是因为边缘开发的混合特性。许多框架尚未完全支持边缘优先的开发模式,这迫使开发者在服务器端渲染和浏览器渲染之间进行选择。然而,新兴框架如 Fresh,则通过默认不向客户端发送 JavaScript,简化了边缘优化过程。开发者使用 Fresh 和 Deno Deploy 的全球分布式 JavaScript 无服务器边缘网络,能够实现如 Lighthouse 评分满分的性能优化。

结论

边缘计算代表了互联网发展的下一阶段。从 IBM 360/91 到 Berners-Lee 的 NeXT 机器,再到 Akamai 的 CDN 和亚马逊的数据中心,无服务器架构以及如今的边缘计算。每一个阶段都是在前一阶段的基础上发展而来,汲取经验,修正错误。边缘计算将使互联网成为一个更快、更安全的场所,为用户和开发者带来更好的体验。

希望本文能帮助大家更好地理解边缘计算的价值及其对未来互联网的影响。如果你有任何想法或疑问,欢迎在评论中与我们交流!