昨天很多人被一条消息炸到了,Claude 上线了身份验证,要你交护照照片加实时自拍。

群里瞬间炸了。有人说「我寻思着我就写个代码,咋还得刷脸了」,有人说「这下好了,连绕路都不够用了,还得造身份」。

我用 Claude 系列产品差不多快两年了,从最早的 API 到后来的 Claude Code,几乎天天在用,写代码、写方案、搞分析。所以这次身份验证的事,不是隔岸观火,是直接打在我身上的。

也正因为用得深,我对 Anthropic 这家公司这几年干的事看得比较清楚。今天不想只聊身份验证本身,想把它背后那条线索捋一捋。

很多小伙伴可能觉得,这不就是合规嘛,美国公司搞个验证有啥好说的?

没那么简单。

如果你把 Anthropic 这几年的政策串起来看,你会发现一个非常清晰的趋势,它在一步步构建一座围墙。每一块砖看起来都合情合理,但砌到最后,墙里的人发现自己越来越难出入了。

咱们从头捋。

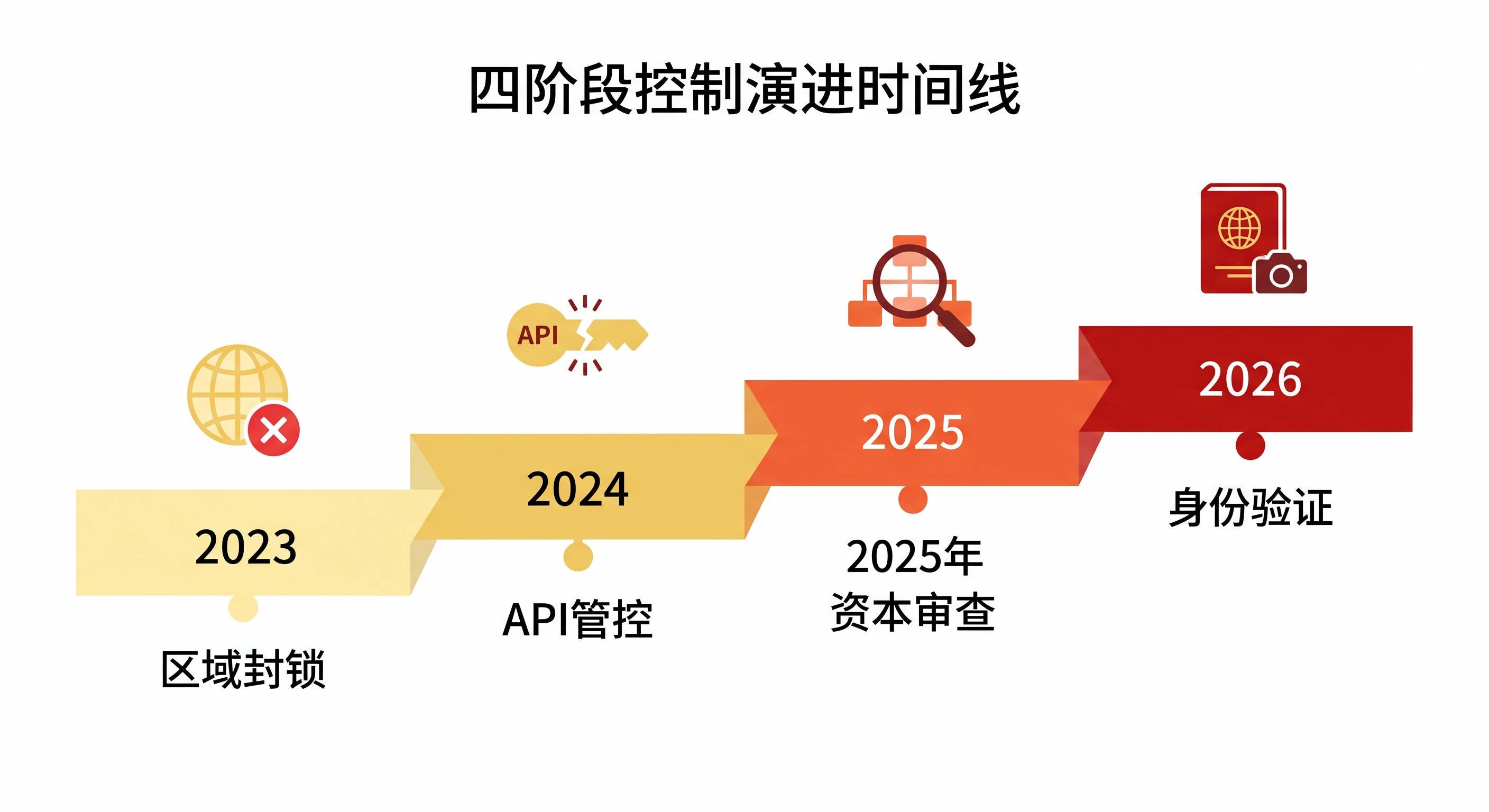

Anthropic 的封闭之路,大致可以分成四个阶段。

第一阶段是区域封锁。2023 年 Claude 上线,一批国家直接进了「不支持」名单,中国、俄罗斯、伊朗、朝鲜。这个阶段大家没太在意,OpenAI 也差不多,美国 AI 公司基本都这样。

第二阶段是 API 管控。2024 年 OpenAI 率先封锁了中国区 API,给了开发者不到一个月缓冲期。Anthropic 跟进。这一刀下去,大量靠 Claude API 做产品的中国开发者被迫迁移,有的花了两个月才把业务切到别的模型上,客户掉了一截。

第三阶段是资本审查。2025 年 9 月,Anthropic 更新了服务条款,打击面从「在中国的公司」扩大到了「被中国资本控股超过 50% 的公司」,不管你注册在新加坡还是开曼群岛。据《金融时报》报道,这一刀砍掉了「低数亿美元」量级的收入。Anthropic 是明知道亏钱,还是做了。

第四阶段就是昨天的身份验证。护照照片加实时自拍,由第三方公司 Persona 处理。官方说法是防止滥用、遵守法律义务。

大家注意看这四步,从封国家到封公司到封个人,打击精度越来越高,颗粒度越来越细。

这让我想到一个东西,机场安检。

911 之前,坐飞机基本不用脱鞋。然后是脱鞋,然后是开箱检查,然后是全身扫描,然后是液体不能超过 100 毫升。每一步都有道理,每一步都为了安全。但二十多年过去了,坐飞机的体验越来越差。

而真正想搞事的人,从来不走正门。

Anthropic 的安全策略走的是同一条路。

说到这里,可能有小伙伴纳闷了,为啥 Anthropic 比 OpenAI 还激进?OpenAI 也封了中国,但人家至少没搞到「查你股东是哪国人」这个地步。

要理解这件事,得从 Anthropic 的创始人说起。

Dario Amodei,意大利裔美国人。他父亲 Riccardo 是一个来自托斯卡纳的皮革匠人,母亲 Elena 是芝加哥出生的美国人,在伯克利给图书馆做装修项目管理。这个家庭组合不是典型的硅谷精英家庭,倒更像你在旧金山湾区随便转转就能碰到的那种中产。

Dario 本人是加州理工的物理学出身,后来转到普林斯顿读了生物物理学博士。转学科的原因很关键,2006 年他父亲 Riccardo 因为一种罕见疾病去世了。那个病在当时大约 50% 的致死率,但仅仅四年后,一项新的医学突破把这个数字降到了 5%。

四年。就差了四年。

这件事对 Dario 的影响极大。它让他建立了一个非常强烈的信念,技术进步可以救命,但如果进步的方向被扭曲或者速度被拖慢,代价是具体的人的生命。这也是为什么他后来一头扎进了 AI 安全领域。

2016 年 Dario 加入 OpenAI,参与了 GPT-2 和 GPT-3 的开发,做到了研究副总裁。但 2021 年他带着妹妹 Daniela 和一批高管集体出走,创办了 Anthropic。

出走的公开理由是「对 AI 安全的方向有分歧」。Dario 认为 OpenAI 在安全上做得不够,太急着商业化了。

注意这个逻辑,他觉得世界上最知名的 AI 安全机构还不够安全,所以自己出来做一个更安全的。

这个出发点我完全理解。一个因为「技术晚到四年」失去父亲的人,对风险的感知天然比一般人更敏锐。这甚至可以说是一种美德。

但问题在后面。

当「安全」从一个技术理念变成了公司的核心身份标签,它就不可避免地会从技术层面滑向政治层面。

Dario 在 2024 年发表了一篇长文叫「Machines of Loving Grace」,2026 年又写了续篇「The Adolescence of Technology」。他在文中列了五类 AI 风险,其中一条特别值得关注,就是 AI 被「对抗性国家」用于军事和情报用途。

当一个公司的创始人把「对抗性国家」写进了核心风险框架,后面发生的所有事情就都有了根基。

Anthropic 内部有一份文件,把中国定性为「adversarial nation」。这不是泄密,是他们公开政策的直接延伸。

2025 年有过一次因为这件事引发的内部地震。一个叫姚顺宇的华人研究员,斯坦福理论物理博士,2024 年 10 月加入 Anthropic,直接参与了 Claude 3.7 Sonnet 的开发。但不到一年他就离职了,去了 Google DeepMind。

他公开写了一篇博文,说离职原因中 40% 是因为 Anthropic 把中国定性为「对抗性国家」。他说他相信公司大多数人不认同这种措辞,但作为一个中国人,他没法继续待下去。

一个参与核心产品开发的研究员,因为公司的地缘政治定位而出走。这个信号很重要,它说明 Anthropic 的安全叙事已经不只是技术框架了,它在影响人才的去留。

说到这里,可能有人会问了,Anthropic 这些限制到底有没有用?能不能真的挡住恶意使用?

我觉得大家可以看一个历史案例。

1949 年冷战刚开始的时候,美国牵头搞了一个叫 COCOM 的国际组织,全名「巴黎统筹委员会」,专门协调西方国家对苏联的技术出口管制。半导体、计算机、精密机床,统统上了禁运名单。

这个体系运行了 45 年,直到 1994 年苏联解体后才解散。

效果怎么样呢?

1986 年 CIA 自己做过一个评估,说苏联半导体产业落后美国大约八到九年。但 CIA 同时也说,这个差距更多是苏联自己的生产管理问题导致的,COCOM 封锁「可能」是因素之一,注意措辞,是「可能」。

更打脸的是 1987 年曝出的东芝丑闻。日本东芝和挪威康斯贝格偷偷卖给苏联先进的铣床,让苏联海军造出了更安静的潜艇。COCOM 管了 38 年都没管住一台铣床。

45 年的技术封锁,史上最严密的多国协调出口管制,最后 CIA 自己都承认效果有限,而且最大的漏洞来自内部。

现在把这个故事和 Anthropic 放在一起看。

你觉得一个身份验证加一个服务条款,能挡住什么?

真正想搞事的机构和个人,开个壳公司,用第三国护照,通过 AWS Bedrock 间接调用,方法太多了。COCOM 管不住一台东芝铣床,Anthropic 的身份验证能管住一个懂点网络技术的工程师?

被挡住的永远是那些想正经用 Claude 写代码、做研究、搭产品的普通开发者。他们不仅贡献收入,还贡献使用场景反馈和社区生态。

这就是安全悖论的经典表现。就像机场安检升级了无数次,但后来真正造成伤亡的恐怖袭击,几乎没有一次是在机场安检环节发生的。安检越严,走正门的人越少,绕道的一个也没少。

当然了,也不能说 Anthropic 完全没道理。美国政府确实在收紧对中国的技术出口管制,AI 领域尤其敏感。一家在美国融了上百亿美元的公司,不配合政策方向基本不现实。

但配合政策和主动激进,是两件事。

OpenAI 封了中国 API,没搞资本审查。Google 的 Gemini 在不少地区还能用。Meta 直接把 Llama 开源了,你想在哪跑就在哪跑。同样是美国 AI 公司,同样面对差不多的政策环境,Anthropic 选了最激进的那条路线。

这不是被逼的,是选的。

为啥选这条?因为从 2021 年 Dario 出走 OpenAI 的那天起,「我们比所有人都更安全」就是 Anthropic 的核心叙事。这个叙事帮他们融到了钱、招到了人、拿到了独特的市场定位。

但叙事这个东西是有惯性的。一旦你把「安全」举到了最高处,你就很难在任何一个具体问题上选择宽松,因为每一次宽松都是在自己的核心故事上打折。

所以身份验证不是终点,是中间站。按这个惯性走下去,下一步大概率是更严格的免费用户限制,或者更激进的内容过滤。

回到咱们自己的处境。

如果你也在用 Claude,不管是写代码还是做别的,这件事给你的信号已经很明确了,不要把全部家当押在一家公司的善意上。

Claude 的技术实力毫无疑问是顶级的。就说代码能力,目前大概率是业界最强的那一档。

但有个很讽刺的事你想想,我正在用的这个工具,它的母公司正在想办法让我更难用到它。

工具终究是工具。你不能在别人随时可能收回去的地基上盖房子。

国产模型这两年进步飞快。DeepSeek 在推理和代码上已经打到了第一梯队。开源的 Qwen、Llama、Mistral 你可以跑在自己机器上,不用看任何人脸色。

多条腿走路不是因为某一条腿不好,是因为只有一条腿的时候,别人砍你一刀你就倒了。

当然了,也不用太焦虑。Anthropic 的限制主要打的是直接使用 Claude 的场景,如果通过 AWS Bedrock 或者其他云平台间接调用,政策执行有时候会不太一样。而且技术领域变化快,现在看着铁板一块的限制,过两年说不定就松动了。

不过有一件事我觉得值得大家认真想想。

Anthropic 的案例揭示了一个更深的东西,那就是当一家公司把某种价值观变成商业品牌的时候,这个价值观就不再是单纯的理念了。它变成了一种路径依赖。

Dario Amodei 大概率是真心相信 AI 安全很重要的。一个因为「技术晚到四年」而失去父亲的人,他对风险的感知比我们任何人都深。这一点我不想否认,甚至非常尊重。

但当「安全」变成了公司的身份标签、融资故事和竞争壁垒,它就必须不断升级、不断加码。否则叙事塌了,公司的根基也就塌了。

用户在这个过程中,不是被保护的对象,而是被管理的对象。

这条路不只适用于 Anthropic,也适用于任何一家以价值观立身的公司。当价值观变成了品牌,它迟早会反噬使用者。

就像机场安检,你不能因为曾经有人带了危险品,就要求所有人飞行前先做一次全身 CT。安全的边界如果无限扩张,最后得到的不是更安全的天空,而是一个没人愿意坐飞机的世界。

所以咱们能做的,就是别把自己的工作流绑死在任何一家公司的善意上。

善意是会变的,能力留在自己手里才是真的。

我是小盒子,咱们下篇见。